La Mona Lisa habla… y otros también

Más de cinco millones de visitas acumuló el video de Obama publicado por YouTube en abril del año pasado donde aseguraba que «Donald Trump es un completo idiota».

Aunque no deja de tener razón lo enunciado, el video es totalmente falso. El expresidente norteamericano nunca se pronunció de tal modo sobre su sucesor. El audiovisual fue creado precisamente para evidenciar cuán fácil se puede manipular contenido multimedia y engañar a millones.

Es lo que permite la inteligencia artificial y cuando sesta se hermana con inteligencias humanas movidas de malas intenciones, entonces muchísimas cosas se ponen en peligro.

Cada vez proliferan más las conocidas Fake News o noticias falsas, y junto a ellas, también van haciéndose también espacio en la red de redes y en todos los soportes portables los videos falsos.

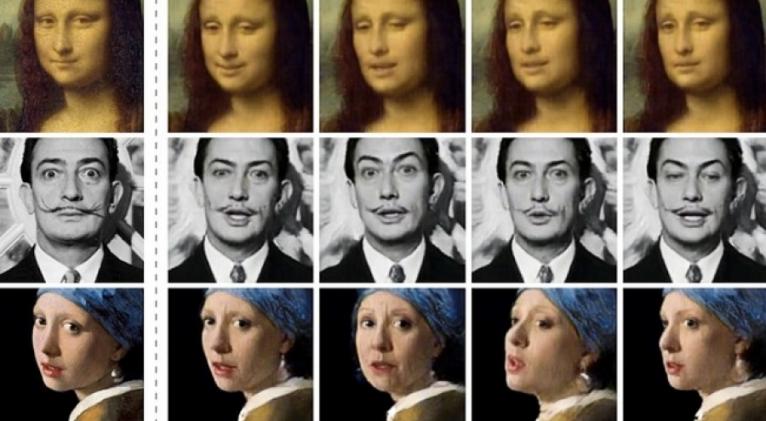

Entre los más recientes se replican por estos días unos en que puede verse hablando, como grabado ayer, a la mismísima Mona Lisa, Marilyn Monroe, y nada menos que a Fiódor Dostoyevski.

No estoy muy segura de qué hubiera podido decir el connotado escritor ruso de verse flanqueado en este presente por tales figuras, pero lo cierto es que los audiovisuales en realidad resultan sorprendentes por lo refinado de sus resultados.

¿Cómo?

La varita mágica que permite tales «milagros» es una herramienta conocida como Deepfake que se ha convertido en pesadilla para muchos, sobre todo famosos, incluyendo al propio Mark Zuckerberg, fundador de Facebook .

Consiste en una alternativa de la inteligencia artificial que marcará un punto de inflexión en la generación de contenidos falsos y también en la desinformación.

Empezó a mostrar sus garritas en 2017 con la aparición de supuestos video porno protagonizados por estrellas de Holliwod como Scarlett Johansson, Gal Gadot y Katy Perry. En realidad ninguna de esas estrellas incurrió en tal «resbalón».

Deepfake equivale en inglés a la unión de «deep learning» (aprendizaje profundo) con «fake» (falso). Se trata de una rama de la inteligencia artificial donde los sistemas de manera autónoma aprenden a analizar datos y realizar tareas.

Mapean las expresiones faciales de alguien, y luego, el mismo programa crea con esa información un nuevo video.

Sí que llega hondo esta farsa al trucar de modo súper realista rostros y voces. La aplicación suplanta el rostro de una persona, hoy a partir incluso de una sola fotografía, por una máscara inteligente.

El profesor de ciencias de la computación Hany Farid, especializado en análisis de imágenes y percepción humana, llamado el «padre de la imagen forense digital», ha referido que «cada vez se necesitan menos datos» para «generar contenidos más sofisticados y convincentes».

A simple vista casi es imposible descubrir la falsificación, casi. Pero la culpa de que algunos de esos trucajes resulten malsanos no es de la tecnología, como no lo es de la tijera por cortar en pedacitos una carta importante.

Aseguran que ya desarrollan sistemas que detectarán cuándo un video ha sido manipulado o falsificado.

Mientras no se disponga de tal herramienta, sí existen alternativas para descubrir la trampa: en los Deepfakes solo suele aparecer la cabeza de la persona -otra parte del cuerpo confundiría al algoritmo-. Además, lo que más los descubre es que las personas en esos video NO parpadean.

En la vida real, los seres humanos parpadean como media unas 17 veces por minuto, y si están hablando, lo incrementan a 26. Los parpadeos se reducen a 4,5 por minuto si están leyendo. Y si no hay ningún parpadeo... entonces es un Deepfakes.

Las dos caras del vizconde

Con independencia de los malos fines con que pueda emplearse, también esta herramienta muestra un rostro agradable: la posibilidad de «revivir» figuras valiosas y entrañables en la historia de la humanidad.

Ese es el caso, por ejemplo, del proyecto puesto en marcha por el Museo Salvador Dalí, en St. Petersburg, Florida, donde bajo el nombre «Dalí vive» , una expo, casi más surrealista que los cuadros del artista español, ofrece la posibilidad de interactuar con una representación del artista.

En la misma línea artística han logrado «hacer hablar» en un video a La Mona Lisa, gracias a la tecnología de Deepfakes.

Empleando el mismo principio de puntos de referencia de los movimientos de un «rostro objetivo» sobre los de un «rostro fuente», igual consiguieron que Marilyn Monroe o Albert Einsten gesticulen y pareciera que hablan.

Los investigadores moscovitas involucrados en la novedad llaman a su resultado «cabezas parlantes neuronales realistas», señala el sitio digital RT. Son algoritmos de auto aprendizaje que continúan auto perfeccionándose.

Al margen de estas sanas posibilidades, la producción de vídeos falsos con uso de inteligencia artificial ya ha puesto en alerta a varios puntos del planeta.

Ocurre que también han sido usadas en campañas electorales así como con otros fines políticos. Y lo peligroso del asunto es que los receptores de dichos video no se detienen mucho a indagar sobre su autenticidad. Simplemente lo observan, a veces le dan «me gusta» y lo constituyen en verdad aunque no lo sea.

Luego, volver atrás, desmentir, aclarar, y poner las cosas en su lugar ya es casi imposible por la celeridad con que transcurren las informaciones en la red de redes y por el modo en que actualmente los cibernautas se apropian de las mismas.

De tal modo, los Deepfakes pueden ser usados, y de hecho ya los han empleado así, para difundir falsos rumores que hagan dudar sobre hechos auténticos, para difundir francas mentiras, y para difamar sobre determinadas personalidades del ámbito político.

La última intención se hizo tangible este mismo mes, cuando se hizo circular un falso video sobre la presidenta de la Cámara de Representantes de Estados Unidos, la demócrata Nancy Pelosi, donde se le hace aparecer en supuesto estado de embriaguez.

Un representante de Facebook respondió a la CNN que esa red social no tiene una política que estipule que la información que las personas publican en Facebook debe ser verdadera. Entre las disposiciones que pueden tomar para hacer frente a la propagación de información falsa, dijo, está el hacer que dicha información engañosa aparezca menos en el “feed” de noticias de la red social para que la vean menos usuarios. Solo eso.

Hará falta una cada vez mayor fiscalización y control de la industria y el mundo digital, mayor responsabilidad por parte de las redes sociales en particular. Pero, aun si algo tan complicado aconteciera, no parece errado pronosticar que, al menos hasta 2020, durante la siempre azarosa campaña electoral estadounidense, junto a las fake news ahora continuarán proliferando, como la verdolaga, también los Deepfakes. Pobre Doña Verdad.

Añadir nuevo comentario